https://arxiv.org/pdf/1406.2661

✳️ [GAN: Generative Adversarial Nets] 논문 공부

✳️ [GAN: Generative Adversarial Nets] 논문 리뷰

1. Introduction

논문에서 다루고 있는 주제가 무엇인지와 해당 주제의 필요성이 무엇인가

논문에서 제안하는 방법이 기존 방법의 문제점에 대응되도록 제안 되었는가

▪️ 주제와 필요성

이 논문은 생성 모델을 학습하는 새로운 방식으로서 적대적 생성 신경망(Generative Adversarial Nets, GAN)을 제안

기존 생성 모델들은 확률 분포를 명시적으로 정의하고, 근사 추론이나 MCMC 기반 샘플링이 필요해 학습이 느리고 복잡

▪️ 기존 방법의 문제점 대응 여부

GAN은 확률 분포를 직접 정의하지 않고, 오직 생성자(G)와 판별자(D)의 적대적 게임을 통해 학습함으로써

추론(inference)이나 마르코프 체인(MCMC) 없이도 강력한 생성 능력을 가진 모델을 구성할 수 있게 한다.

논문이 다루는 분야

▪️ 분야

- 딥러닝 기반 생성 모델 (Deep Generative Models)

- 비지도 학습 (Unsupervised Learning)

- 확률 모델링 및 샘플링 (Probabilistic Modeling & Sampling)

해당 task에서 기존 연구 한계점

▪️ 기존 한계점

- MLE 기반 모델: 계산 복잡성, 근사 추론 필요

- RBM/DBM: MCMC 기반 샘플링 → 느림, burn-in, mixing 문제

- Autoencoder 기반 모델: 명시적 확률 분포 어려움

논문의 contributions

▪️ 논문의 주요 기여 (Contributions)

- 생성 모델을 학습하는 전혀 새로운 방식인 GAN 프레임워크 제안

- 마르코프 체인 없이 빠르고 안정적인 샘플 생성 가능

- G와 D가 미분 가능한 네트워크이면 역전파만으로 전체 학습 가능

- 실제 이미지 생성 실험을 통해 기존 생성 모델과 경쟁 가능한 결과 제시

2. Related Work

Introduction에서 언급한 기존 연구들에 대해 어떻게 서술하는가

제안 방법의 차별성을 어떻게 표현하고 있는가

▪️ 기존 연구 서술

- RBM, DBM 등 무방향 그래픽 모델: 분할 함수, MCMC 샘플링 필요

- Deep Belief Network(DBN): 방향성과 무방향 결합 → 학습 복잡

- Autoencoder 기반 모델: Score Matching, NCE 등 확률 추정의 제약 존재

- GSN, VAE: 추론 또는 샘플링에 MCMC나 근사 기법 요구

▪️ 제안 방법의 차별성

- GAN은 추론 과정 없이도 학습 가능

- 마르코프 체인 없이 한 번의 순전파로 샘플 생성 가능

- 판별 모델을 통해 생성자를 간접적으로 학습 → 강한 regularization 효과

3. 제안 방법론

Introduction에서 언급된 내용과 동일하게 작성되어 있는가

Introduction에서 언급한 제안 방법이 가지는 장점에 대한 근거가 있는가

제안 방법에 대한 설명이 구현 가능하도록 작성되어 있는가

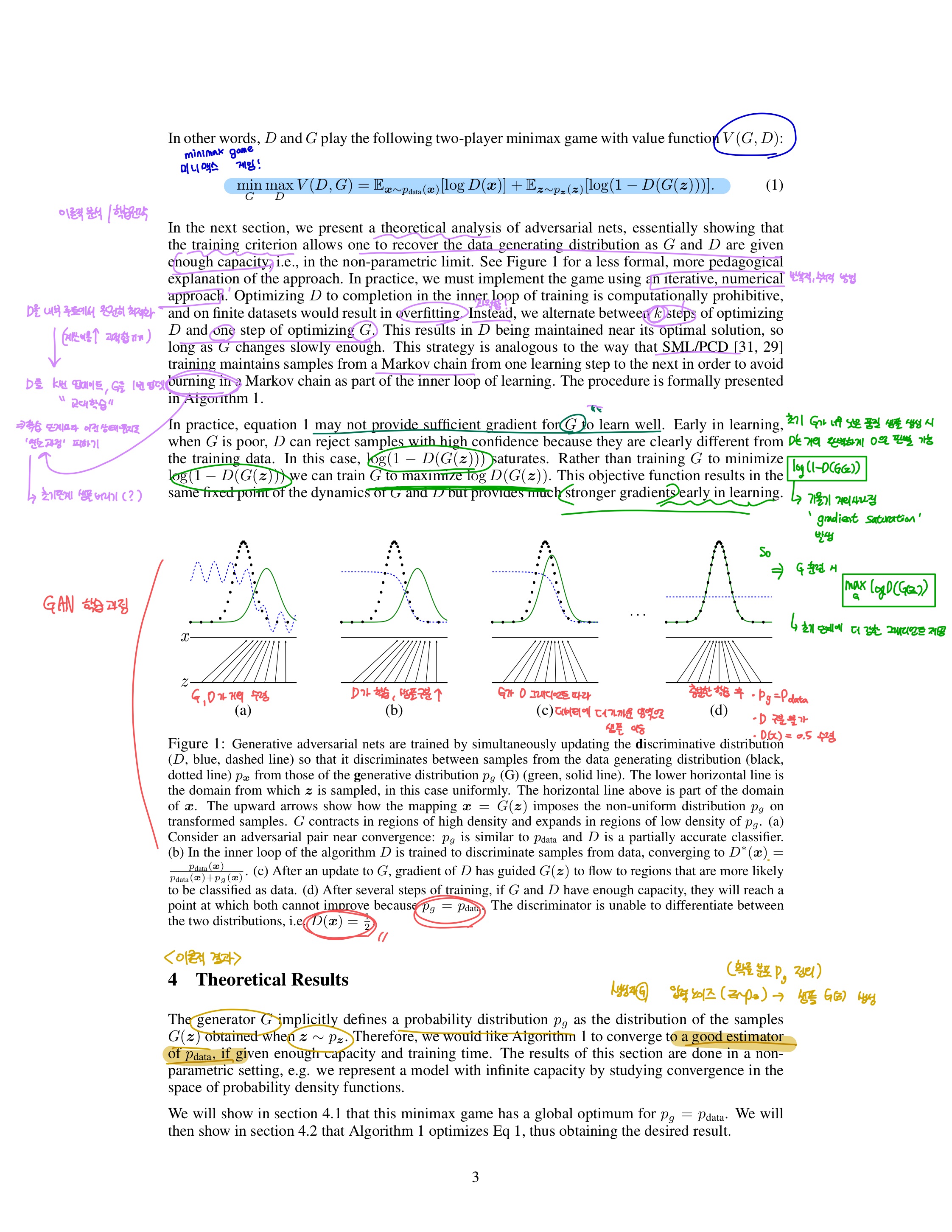

▪️ 내용의 일관성

- Introduction에서 설명한 적대적 구조(G vs D)의 개념이 그대로 제안 방법에서 수식과 함께 구체화됨

- min_G (max_D V(D, G) ) 구조의 미니맥스 게임으로 전체 학습 목표 정의

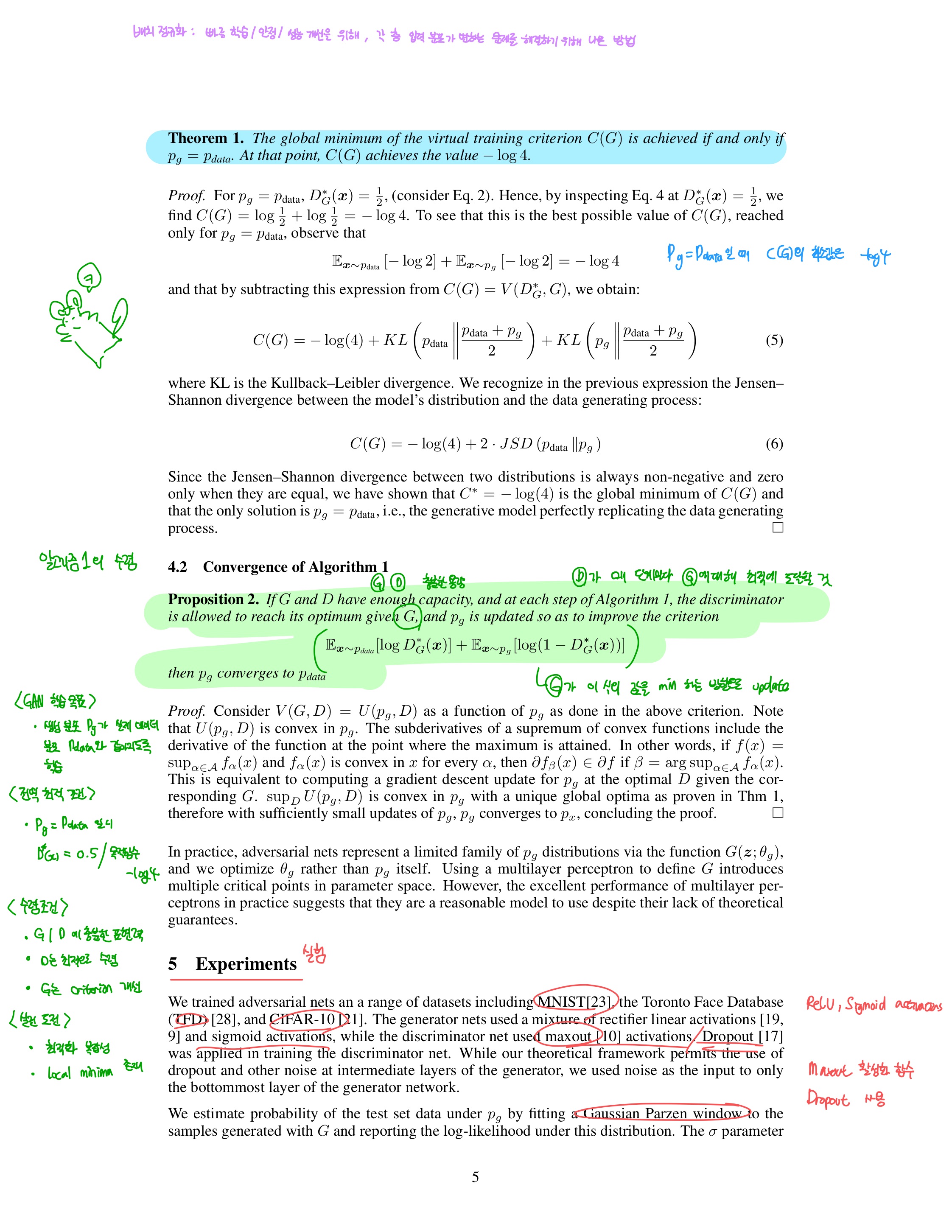

▪️ 장점의 근거 제시

- 수학적으로 전역 최적 조건: p_g = p_data일 때 수렴함을 증명

- 추론, MCMC가 불필요함을 이론적으로 설명

▪️ 구현 가능성

- 알고리즘 1로 학습 절차를 명확히 기술 (미니배치 SGD 기반)

- ReLU, sigmoid, maxout 등 구체적인 네트워크 구조까지 언급

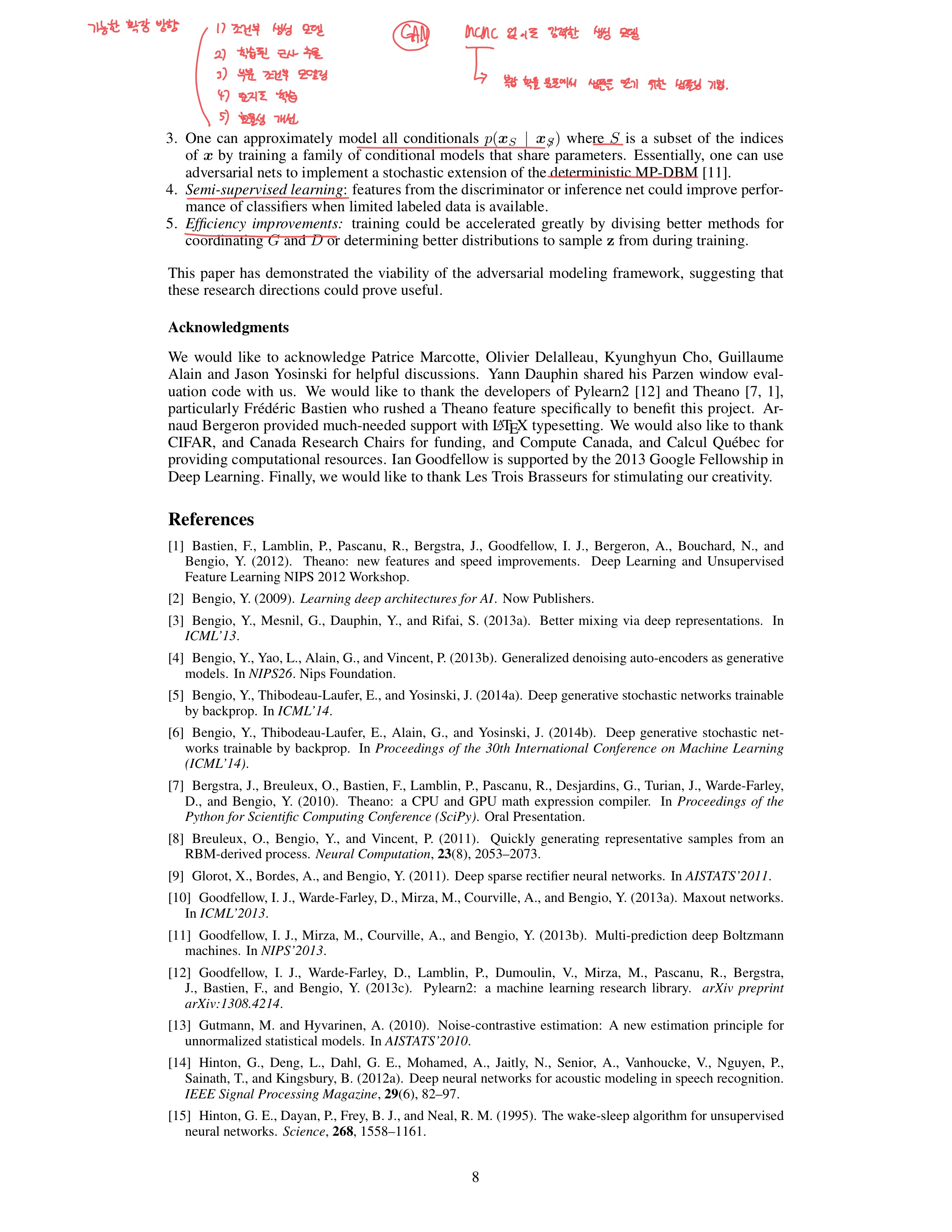

Main Idea

- 두 네트워크(G, D)를 적대적으로 학습시켜, 데이터 분포를 복원하는 새로운 학습 프레임워크 제안

Contribution

- 기존 생성 모델의 구조적, 계산적 한계를 극복

- 샘플 생성의 효율성과 표현력 확보

- 다양한 확장 가능성 (Conditional GAN, Semi-supervised GAN 등) 열어줌

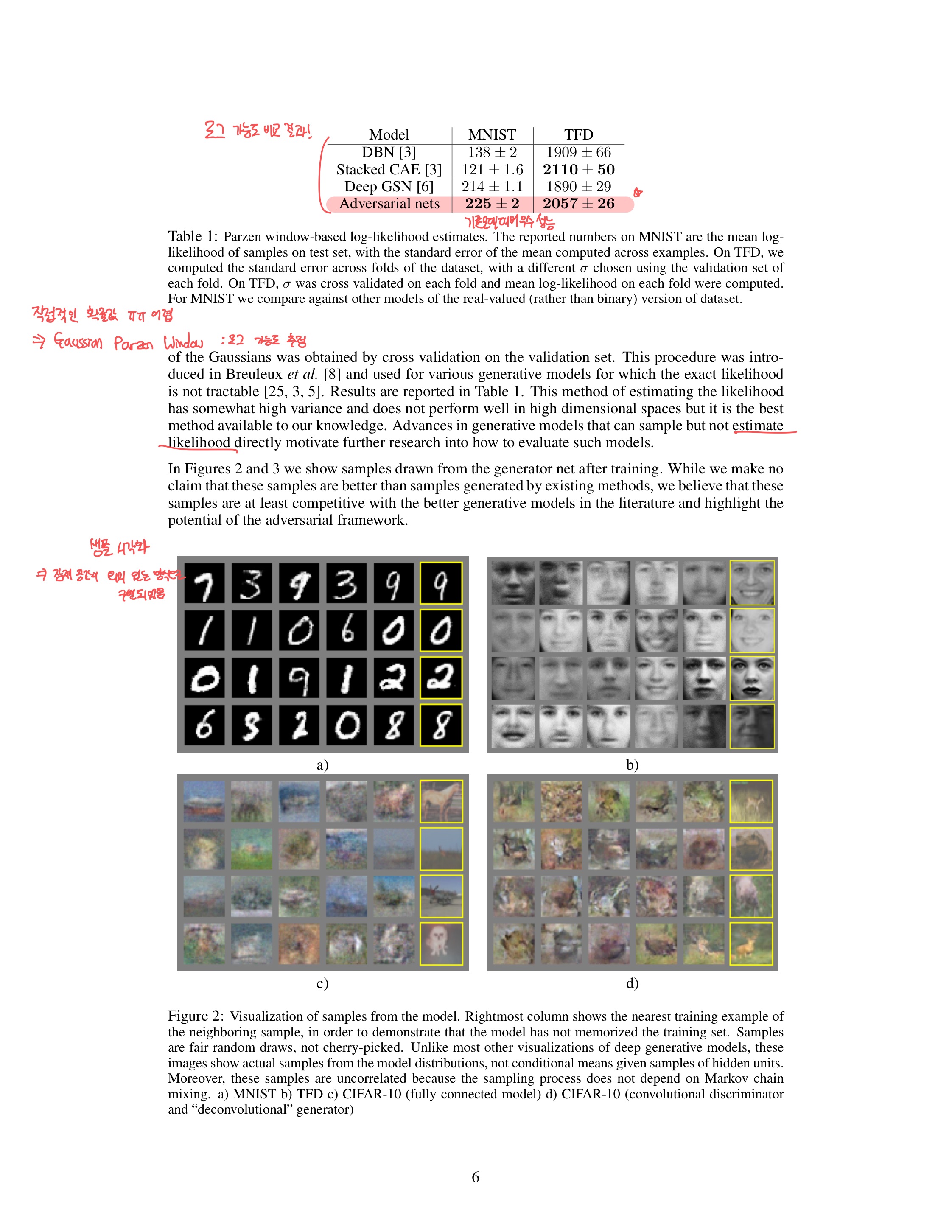

4. 실험 및 결과

Introduction에서 언급한 제안 방법의 장점을 검증하기 위한 실험이 있는가

Dataset

- MNIST, TFD (Toronto Face Dataset), CIFAR-10

Baseline

- Deep Belief Network (DBN)

- Stacked Contractive Autoencoder (CAE)

- Deep GSN 등 기존 생성 모델

결과

- Parzen window 기반 로그 가능도 측정

- MNIST: GAN이 최고 성능 기록 (225 ± 2)

- TFD: 경쟁력 있는 성능 확보 (2057 ± 26)

- 생성된 이미지 샘플은 실제 학습 샘플을 암기한 것이 아님을 시각적으로 검증

- Markov chain 없이도 상관 없는 샘플을 빠르게 생성 가능

5. 결론 (배운점)

연구의 의의 및 한계점, 본인이 생각하는 좋았던/아쉬웠던 점 (배운점)

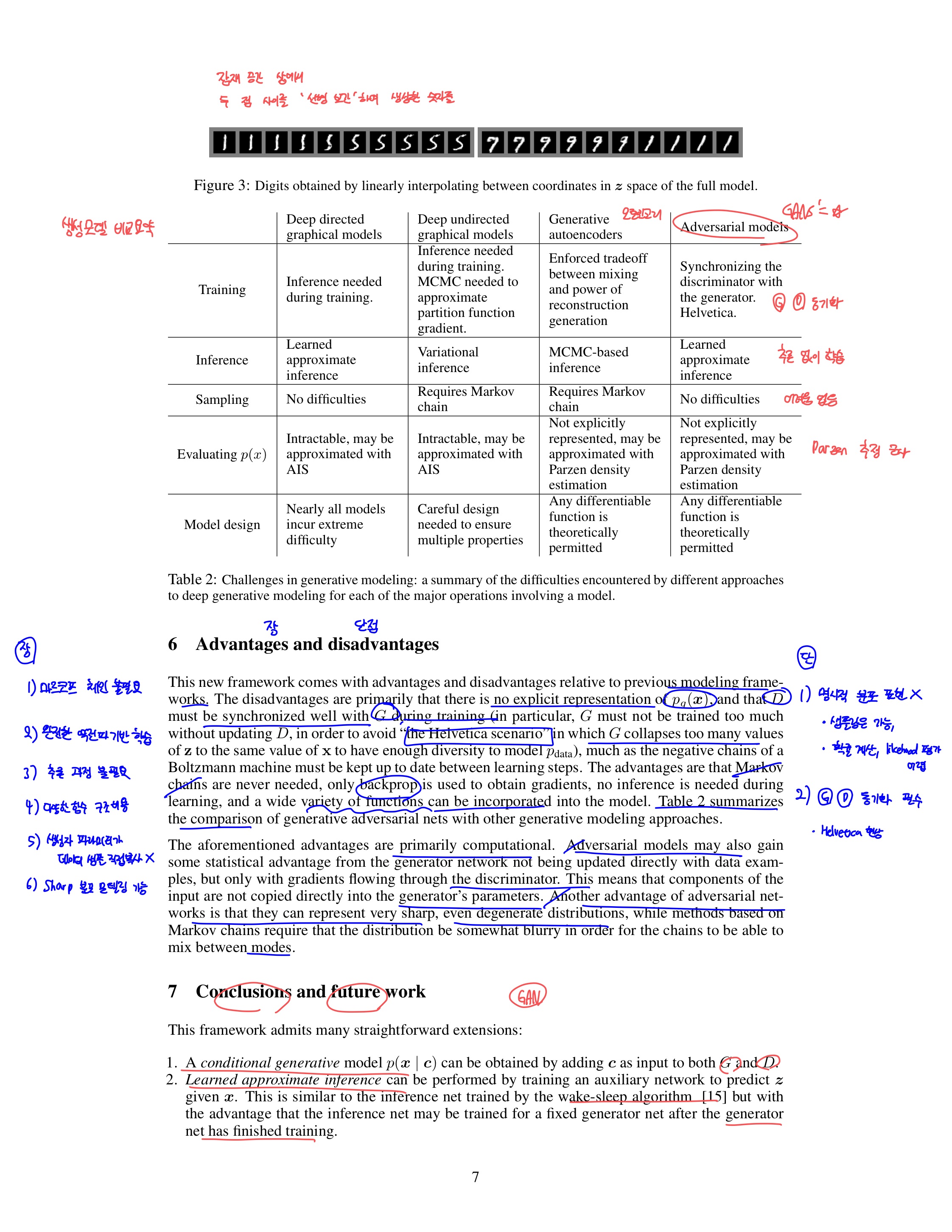

▪️ 연구의 의의

- 생성 모델 학습에 있어 비추론적이고 효율적인 새로운 접근 방식을 제시

- GAN은 딥러닝의 대표적인 “end-to-end” 생성 모델로서 새로운 패러다임을 열었음

▪️ 한계점

- 모드 붕괴(Mode Collapse) 현상 발생 가능 (Helvetica Scenario)

- 명시적 분포 p(x) 가 존재하지 않아 확률적 평가가 어렵다

▪️ 좋았던 점 (배운 점)

- 복잡한 확률적 모델 없이 단순한 적대 구조만으로도 고성능 생성이 가능하다는 점

- 딥러닝의 함수 근사 능력과 최적화 전략(backprop)만으로 모델 전체가 동작하는 구조의 아름다움

- 이후 등장한 다양한 GAN 확장 (cGAN, WGAN, CycleGAN 등)의 출발점이 된 기초 논문

끄앙 어려워

'Club|Project > Euron | AI,데이터분석 학회' 카테고리의 다른 글

| 🪼 강화 학습 - MDP를 위한 벨만 방정식 : 딥러닝 파이토치 교과서 (0) | 2025.03.28 |

|---|---|

| Generative Adversarial Nets : 발표 정리 (0) | 2025.03.25 |

| 🪼생성 모델 : 딥러닝 파이토치 교과서 (0) | 2025.03.23 |

| 🧠 Transformer architecture (0) | 2025.03.20 |

| ✳️ [GAN: Generative Adversarial Nets] 논문 공부 (0) | 2025.03.20 |